Artificial intelligence (AI) is gebaseerd op de vier pijlers: compute, data, algoritmes en de mens. De mogelijkheden van AI zijn intussen zo evident dat zelfs critici toegeven dat deze technologie ons leven ingrijpend gaat veranderen. AI biedt tal van mogelijkheden om processen en activiteiten in sectoren als de zorg, de auto-industrie of de productie drastisch te optimaliseren. Daarbij staan we nog maar aan het begin van een ontwikkeling die al vele decennia terug begon. Maar hoe begon het eigenlijk?

“Wij stellen voor om in de zomer van 1956 een tweemaandelijks seminar te houden over artificial intelligence met tien deelnemers op Dartmouth College.” Dat schreven computerwetenschapper John McCarthy en drie collega’s aan potentiële subsidieverstrekkers in 1955. De Dartmouth Conference wordt daarom wel de geboorteplek van artificial intelligence genoemd. De term AI refereert aan pogingen om computers zo te programmeren, dat ze problemen kunnen oplossen en onafhankelijk beslissingen kunnen nemen. De intelligentie moet ontstaan door te leren. Dat gebeurt door veel data te verzamelen en analyseren. Een onderdeel van deze machine learning is Deep Learning, dat gebaseerd is op neurale netwerken. Deze netwerken stonden tijdens de Dartmouth Conference al hoog op de agenda, omdat er al aan gewerkt was.

Al in 1943 waren wetenschappers bezig met neurale netwerken. Hun bevindingen waren later de basis voor de bouw van een eerste neurocomputer, de SNARC (Stochastic Neural Analog Reinforcement Calculator). De computer was opgebouwd uit 40 buistransistoren en bekabeling. In 1958 bereidde Frank Rosenblatt het concept van kunstmatige neuronen uit naar een adaptief netwerk, de perceptron. Twaalf jaar later publiceerde Seppo Linnainmaa het algoritme waarmee een neuraal netwerk kon leren. Dit werd pas in 1986 in een systeem geïmplementeerd door Geoffrey Hinton en enkele van zijn collega´s. Hun neurale netwerk herkende eenvoudige afbeeldingen sneller dan andere systemen. Het principe dat een machine leert door ervaring geldt nog steeds.

Afnemende en weer toenemende belangstelling

De AI-systemen konden de hoge verwachtingen van die tijd echter niet waarmaken. Probleem waren de storagesystemen die de noodzakelijke capaciteit en I/O-prestaties misten om de grote hoeveelheden data te verwerken, nodig voor machine learning. Daarnaast waren de computers niet snel genoeg voor de complexe berekeningen. Begin jaren tachtig nam de belangstelling voor AI af. Alleen het IBM-systeem Deep Blue, dat wereldkampioen schaken Garry Kasparov in zes rondes in 1997 versloeg, haalde nog de publiciteit. Deep Blue was overigens een expertsysteem, dat niet gebruikmaakte van neurale netwerken.

Het was de Franse computerwetenschapper Yann LeCun die aan de wieg stond van de huidige hype rond AI. Hij presenteerde in 2006 het eerste Convolutional Neural Network (CNN). In plaats van één groot neuraal netwerk om afbeeldingen in één keer te analyseren, is het CNN kleiner en analyseert het afbeeldingen in delen. LeCun is op dit moment Director of AI Research bij Facebook.

De Duitse computerwetenschapper Jürgen Schmidhuber legde in 1991 de basis voor de zogenaamde Recurrent Neural Networks (RNN). Hier leren machines taken die ze eerder niet kenden. Neuronen worden in RRN’s in onderling verbonden lagen geplaatst waarbij de lagen ook weer onderling zijn verbonden. Deze netwerken worden gebruikt voor spaakherkenning, schriftherkenning en machinaal vertalen. In 1997 breidde Schmidhuber, samen met computerwetenschapper Sepp Hochreiter, het systeem uit met ‘long short-term memory’ (LSTM). In de optiek van Schmidhuber zijn Recurrent Neural Networks met LSTM echte deep learning-netwerken. Deep learning is sinds 2016 erg succesvol en de drijvende kracht achter de grote belangstelling voor AI.

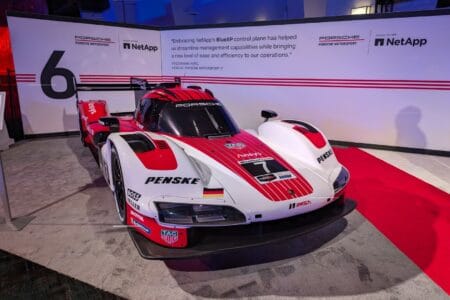

Dit is een ingezonden bijdrage van NetApp. Via deze link vind je meer informatie over de mogelijkheden van het bedrijf.