Nvidia zegt dat het nieuwe records en doorbraken heeft behaald in kunstmatige intelligenties (AI’s) die taal begrijpen. Met de AI’s moet real-time conversational AI in diverse software-applicaties mogelijk worden.

Volgens Nvidia is conversational AI vooral belangrijk voor bedrijven die chatbots en virtuele assistenten willen bouwen voor gesprekken met echte mensen. Het is wenselijk dat de AI dan een menselijk niveau van begrip toont.

De industrie gebruikt dan ook steeds grotere taalmodellen. Probleem is echter dat die modellen ook moeilijker zijn te trainen en deployen, schrijft Silicon Angle. Nvidia heeft op dat punt naar eigen zeggen een aantal doorbraken gehad.

Mijlpalen

Zo heeft het bedrijf de trainingstijd voor één van de meest geavanceerde AI-taalmodellen, de Bidirectional Encoder Representations from Transformers (BERT), terug weten te brengen van meerdere dagen naar slechts 53 minuten.

Ook konden de systemen van Nvidia de tijd die nodig is om AI-inferentie te voltooien verkorten naar ongeveer twee milliseconden. Die tijd is meer dan genoeg om de snelle gesprekken te voeren die mensen gewend zijn.

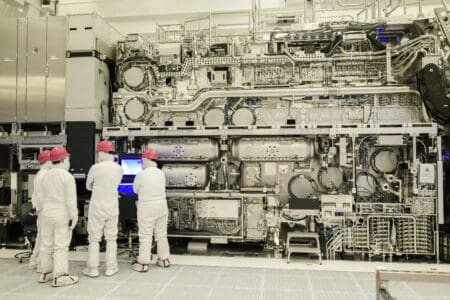

Daarnaast heeft Nvidia naar eigen zeggen een nieuw wereldrecord gezet. Dit deed het met het trainen van BERT-Base. Het trainen duurt normaal gesproken weken, maar werd nu binnen een uur voltooid. Dit was mogelijk door geoptimaliseerde software te gebruiken, evenals het DGX SuperPOD-systeem.

Het TensorRT-platform van Nvidia zette naar eigen zeggen een wereldrecord voor BERT-inferentie met een latency van slechts twee milliseconden. Voor menselijke accuraatheid geldt een drempel van tien milliseconden.

Volgende golf van conversational AI

Nvidia wil met de doorbraken de “volgende golf van conversational AI” aansturen. Bryan Catanzaro, vice president van applied deep learning research bij Nvidia, zegt dat het bedrijf al vooruitgang heeft geboekt op dat gebied.

Nvidia werkt bijvoorbeeld nauw samen met Microsoft, om nauwkeurigere zoekresultaten in Bing mogelijk te maken. Bing en Nvidia optimaliseerden samen de inferentie van BERT aan de hand van GPU’s van Nvidia en delen van de Azure AI-infrastructuur.

“Dat leidde tot de grootste verbetering in de rangschikking van zoekkwaliteit die Bing in het afgelopen jaar heeft geïmplementeerd”, aldus Catanzaro.