Onderzoekers van Google Brain hebben een paper gepubliceerd waarin ze een vijandige methode beschrijven om een machine-learningsysteem te herprogrammeren. Zo kan het systeem worden geherprogrammeerd om een andere taak te vervullen.

“Deze resultaten tonen zowel de verrassende flexibiliteit als de verrassende kwetsbaarheid van neurale netwerken”, schrijven de AI-onderzoekers in hun paper. Hun aanval steunt op een verstoring van de inputgegevens van een neuraal netwerk, om zo het resulterend gedrag te beïnvloeden.

“In computer vision kunnen speciaal gemaakte verstoringen van afbeeldingen ervoor zorgen dat neurale netwerken fouten maken, zoals het identificeren van een panda als een gibbon of het verwisselen van een kat met een computer”, leggen de onderzoekers uit.

Eerdere voorbeelden van aanvallen werden ontworpen om de kwaliteit van neurale netwerken te verminderen of ervoor te zorgen dat ze specifieke resultaten produceren, die door de aanvaller van tevoren zijn gekozen. Het neuraal netwerk blijft in deze gevallen evenwel nog altijd de taak uitvoeren waarvoor het werd geprogrammeerd.

Herprogrammeren

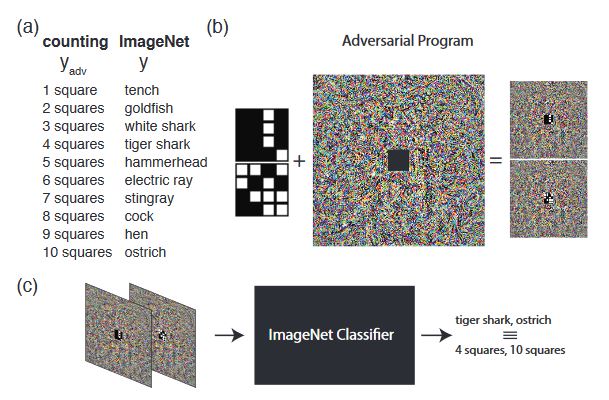

Met de aanval van het Google-team kan met behulp van verstoorde inputdata een neuraal netwerk worden geherprogrammeerd om een compleet nieuwe taak uit te voeren, waar het niet voor is getraind. Om dat te illustreren, pasten de onderzoekers hun methode toe op enkele classificatiemodellen van ImageNet. Dat is een grote beeldendatabank die wordt gebruikt voor visuele objectherkenning.

ImageNet maakt gebruik van meer dan twintigduizend labels om afbeeldingen te categoriseren, zoals bijvoorbeeld “tijgerhaai” of “struisvogel”. Die labels werden door de onderzoekers gekoppeld aan nieuwe labels, in dit geval het aantal vierkantjes in een afbeelding. Door de modellen vervolgens gemanipuleerde beelden te laten verwerken, slaagden de onderzoekers erin om het neurale netwerk de nieuwe taak aan te leren om het aantal vierkantjes te tellen.

Volgens de onderzoekers hoeft hun techniek niet beperkt te blijven tot het herprogrammeren van modellen voor beeldherkenning, maar bijvoorbeeld ook voor audio, video of tekst. Meer onderzoek is evenwel nodig om die hypothese te toetsen.

Kwetsbaarheid of flexibiliteit

In de echte wereld kan deze aanval worden gebruikt om rekenkracht van een fotodienst in de cloud te stelen, bijvoorbeeld om beeldcaptcha’s op te lossen bij de creatie van spamaccounts of – als de hierboven vermelde hypothese klopt – zelfs het mijnen van cryptomunten.

De techniek kan volgens de onderzoekers eveneens worden gebruikt voor meer traditionele hacks. Ze argumenteren dat ook de door AI aangedreven digitale assistenten in onze smartphones gevoelig kunnen zijn voor dit soort aanvallen. “Aangezien deze digitale assistenten toegang hebben tot de e-mail, agenda, sociale media en creditkaarten van een gebruiker, worden de gevolgen van dit type aanval ook groter”, schrijven ze in hun paper.

Toch is de ontdekking van Google Brain niet alleen slecht nieuws. Het is enerzijds een kwetsbaarheid, maar biedt tegelijk ook potentieel voor flexibelere neurale netwerken. “Het belooft om machine-learningsystemen mogelijk te maken die gemakkelijker hergebruikt kunnen worden, flexibeler zijn, en efficiënter kunnen werken dankzij gedeeld computergebruik”, besluiten de onderzoekers.