IBM heeft een machine learning-trainingsmodel op basis van generalisatie ontwikkeld dat zo weinig mogelijk persoonlijke gegevens gebruikt. Hiermee kunnen ontwikkelaars modellen bouwen die in zeer hoge mate voldoen aan de Europese privacywet- en regelgeving GDPR.

Het trainen van ML-modellen met zo min mogelijk persoonlijke gegevens is lastig. Ontwikkelaars hebben moeite met het bepalen van de juiste minimale hoeveelheid persoonlijke gegevens voor het kunnen trainen van ML-modellen voor het brengen van de meest accurate voorspellingen of classificaties.

Big Blue pakt het probleem aan met een nieuwe trainingsoptie waarbij minder persoonlijke data in de trainingsdatasets wordt gebruikt via een ‘generalisatieproces’. Hiermee wordt toch de juiste accuratesse opgeleverd van modellen die wel een grote hoeveelheid persoonlijke gegevens in de trainingsdatasets gebruiken.

Generalisatieproces

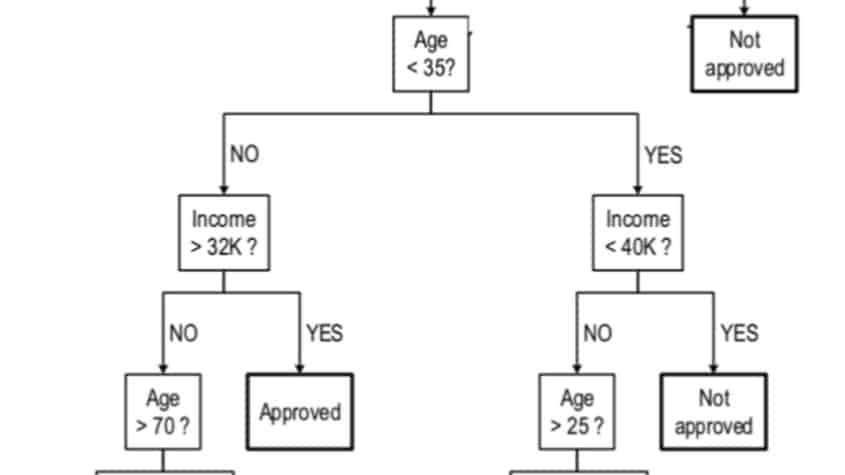

Het trainingsproces verwijdert of generaliseert enkele van de input-eigenschappen van de persoonlijke data die wordt gedraaid. Hierbij wordt de ‘waarde’ van een bepaalde eigenschap in kleinere specifieke en in algemene waardes ‘gebroken’.

Bijvoorbeeld een specifieke leeftijd wordt dan aangeduid in een leeftijdscategorie. Of in plaats van ‘getrouwd/nooit getrouwd/gescheiden’ worden alleen de waardes ‘nooit getrouwd/ gescheiden’ toegekend. Hierbij verdwijnt er een waarde, maar de accuratesse blijft gehandhaafd omdat ‘gescheiden’ impliceert dat iemand ooit getrouwd was.

De gegeneraliseerde waardes worden vervolgens geanalyseerd als een meetgegeven. IBM koos hiervoor het NCP-meetgegeven omdat dit zich het beste zou lenen voor data privacy.

Vergelijking met baseline voor accuratesse

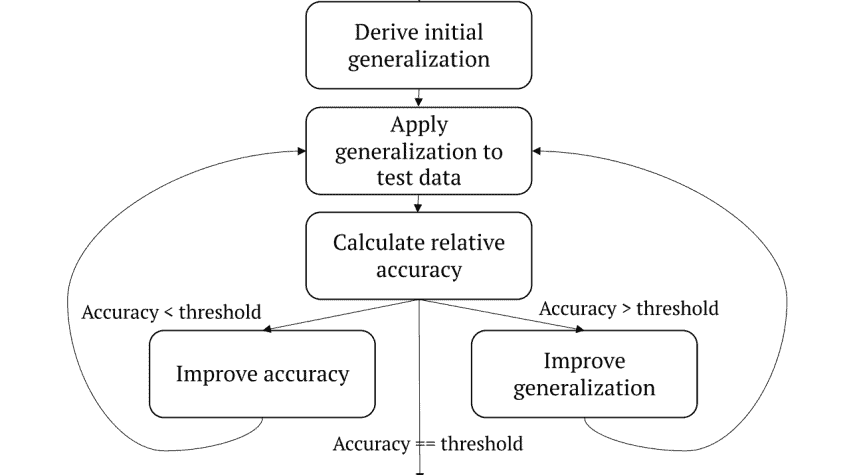

In hun ontwikkelproces selecteerden de onderzoekers van Big Blue een dataset en trainden meerdere target-modellen voor het creëren van een ‘baseline’. Vervolgens werd generalisatie toegepast en werd de accuratesse berekend en opnieuw berekend. Dit ging met zogenoemde beslisbomen die naar boven en beneden kunnen worden aangepast. Hiermee kon de mate van generalisatie worden verhoogd of verlaagd. De uiteindelijke generalisatieuitkomst werd vervolgens vergeleken met die van de baseline en kon zo de accuratesse worden vastgesteld.

Wanneer het hele trainingsproces werd gegeneraliseerd zagen de IBM-specialisten de accuratesse niet onder de 33 procent komen. In sommige gevallen werd zelfs een accuratesse behaald van 100 procent met een beetje generalisatie.

Ook kostenbesparing mogelijk

Volgens Big Blue biedt de nieuwe trainingsmethode vanzelfsprekend veel mogelijkheden voor het voldoen aan privacywet- en regelgeving. Ook levert dit trainingsproces kleinere datasets op, waardoor bedrijven ook kunnen besparen op datastorage en -beheer.