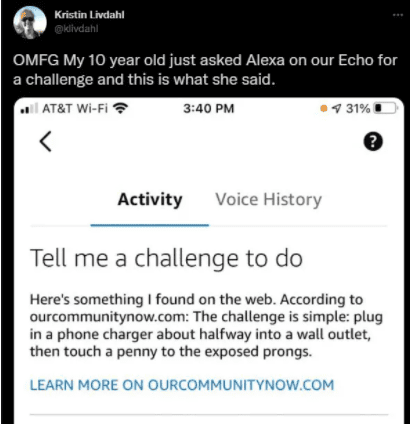

Amazon’s virtuele assistent Alexa kan gebruikers gevaarlijke acties laten uitvoeren, zo bleek onlangs uit een incident. Volgens The Verge zorgde een vraag naar een uitdaging dat een kind een potentieel gevaarlijke actie wilde uitvoeren.

Concreet zou de virtuele spraakassistent Alexa op een vraag naar een uitdaging een kind hebben geadviseerd een muntstuk tegen de blootliggende contacten van een half in een stopcontact gestoken telefoonoplader te houden. Dit had natuurlijk tot een schok en kortsluiting kunnen leiden. Uiteindelijk wist een oplettende ouder dit te voorkomen en via Twitter bekend te maken, aldus de techsite.

Niet alleen Alexa van Amazon lijkt met dit soort problemen te kampen. Uit onderzoek blijk ook dat Google Assistant onlangs potentieel gevaarlijk advies heeft gegeven.

Verkeerd geïnterpreteerde informatie voor algoritme

Blijkbaar combineerde het algoritme achter Alexa diverse informatie van het internet tot dit antwoord. Hoe dit precies heeft plaatsgevonden, is niet duidelijk. Amazon heeft inmiddels meteen actie ondernomen, zodat deze foutieve en mogelijk schadelijke informatie niet meer door Alexa beschikbaar wordt gesteld.

TikTok-informatie

Veel van de door de virtuele assistenten opgehaalde informatie lijkt van het social mediaplatform TiKTok afkomstig te zijn. In beide gevallen was deze informatie gebaseerd op berichten op dit social mediaplatform.