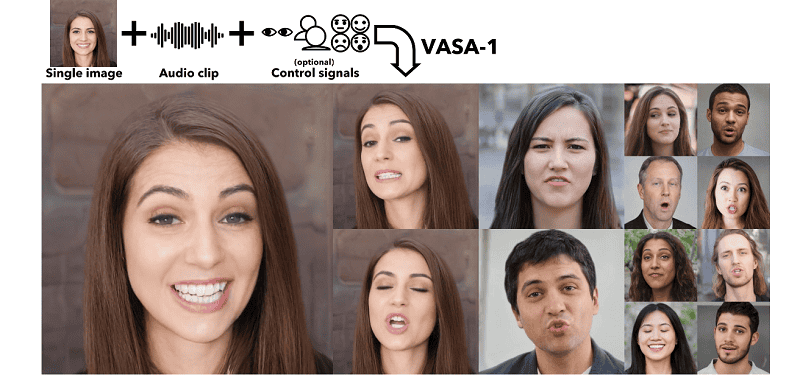

Microsoft heeft onlangs een onderzoek gepubliceerd waarin het bedrijf het AI-model VASA-1 presenteerde. Dit model laat met behulp van portretfoto’s en daaraan gekoppelde audiobestanden realistische ‘talking heads’ zien. Deze technologie biedt creatieve opties, maar brengt serieuze risico’s met zich mee.

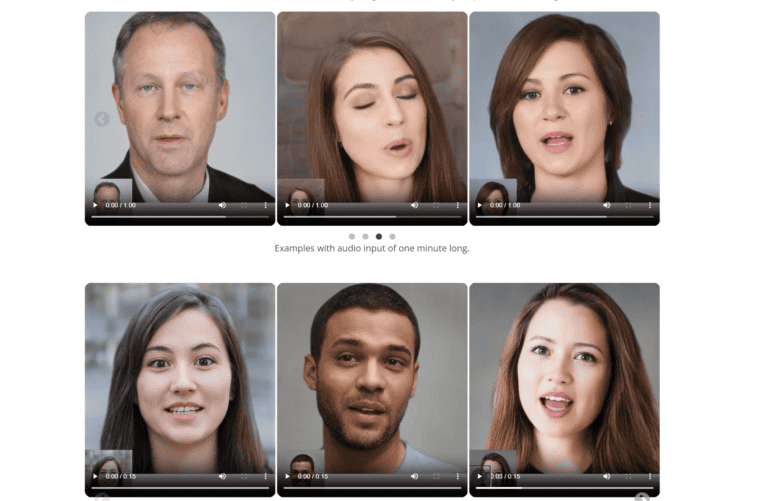

Het VASA-1 AI-model bevindt zich nog in een onderzoeksfase. Microsoft laat al wel zien dat het portretfoto’s van personen in combinatie met audiobestanden ‘realistisch’ kan laten praten. De getoonde gezichtsuitdrukkingen zijn contextgevoelig, waardoor ze zich aanpassen aan de geconstateerde toon van de audio.

Zeer realistisch

De personen in de gebruikte portretfoto’s hoeven niet direct in de camera te kijken. Daarnaast beschikt het AI-model over veel mogelijkheden zoals het bepalen van de blik van de ogen, de afstand tot het hoofd en zelfs van emotionele uitdrukkingen.

Hierdoor krijgen de bewerkte beelden een zeer realistische ‘look and feel’ als zij lijken te praten, stelt Microsoft. Met de technologie zijn deze ‘pratende foto’s’ onder meer in staat liedjes te zingen.

Volgens Microsoft is VASA-1 speciaal ontworpen voor het animeren van virtuele karakters. De beelden die de techreus bij het onderzoek heeft uitgebracht zouden virtuele voorbeelden zijn die zijn aangemaakt met DALL-E van OpenAI.

Use cases en serieuze risico’s

De nieuwe technologie biedt vanzelfsprekend veel mogelijke toepassingen. Vanzelfsprekend kan het gebruikt worden voor het ontwikkelen van meer realistische AI-karakters, compleet met ‘normale’ lipsynchronisatie en gezichtsuitdrukkingen voor meer diepgang. Ook is het het hierdoor mogelijk om avatars aan te maken voor social media-video’s. Microsoft bedacht zelf om ook de Mona Lisa te laten zingen als frappant voorbeeld voor de zeer gevarieerde manieren waarop de technologie gebruikt kan worden.

Toch zijn er ook risico’s aan deze nieuwe AI-technologie verbonden. Als de technologie publiekelijk beschikbaar was, kon het direct leiden tot veel overtuigendere deepfakes. Juist het mogelijk kwaadwillig gebruiken van de technologie is voor Microsoft een reden om de specifieke details van VASA-1 voorlopig nog voor zichzelf te houden. Daarbij waarschuwen de onderzoekers ervoor dat hoewel de technologie goede bedoelingen heeft voor vooral de creatieve sector, de gevaren voor misbruik zeer zeker op de loer liggen.