Google laat weten dat applicaties en workloads voor data engineering en machine learning-toepassingen binnen het Apache Spark-framework nu kunnen draaien binnen Kubernetes clusters. De tool Spark Operator moet dit mogelijk maken.

Met de aankondiging van de bèta release van de dienst Spark Operator wil de techgigant het voor eindgebruikers mogelijk maken meer te halen uit het Apache Spark-platform en zeker in combinatie met Kubernetes clusters.

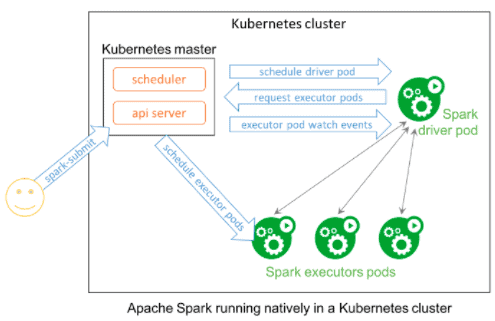

De nu gelanceerde toepassing Spark Operator is een voor Kubernetes aangepaste controller die aangepaste bronnen gebruikt voor declaratieve specificatie van Spark-toepassingen. Zo ondersteunt de toepassing onder meer automatische herstart en op cron-gebaseerde, geplande applicaties. Verder kunnen ontwikkelaars, data engineers en data scientists declaratieve specificaties maken die hun Spark-toepassingen beschrijven en native Kubernetes-tooling, zoals Kubectl, inzetten om hun applicaties te beheren.

Exit Mesos en Hadoop

Een opvallende ontwikkeling is dat de nieuwe tool het gebruik van Apache Spark op on-premise en cloudgebaseerde Hadoop-diensten als Azure HDInsight, Amazon EMR and Google Cloud Dataproc of Mesos clusters kan vergemakkelijken.

Het draaien van Spark workloads binnen een Kubernetes cluster (k8s) was voorheen nog een lastige klus, vooral als eindgebruikers deze workloads binnen een k8s wilden draaien zonder Mesos en zonder toegevoegde Hadoop YARN-strings. Hoewel eerdere versies van Spark zich langzaam deze toepassing ontwikkelden, bleef de uiteindelijke implementatie ervan een lastig proces.

Met de komst van Spark Operator kunnen deze workloads nu gewoon native binnen Kubernetes clusters kunnen draaien. Hierdoor kunnen zij uiteindelijk deze clusters net zo eenvoudig uitrollen als zij met iedere Spark instance zouden doen.

Beschikbaar via GCP Marketplace

Spark Operator is nu direct verkrijgbar via de Google Cloud Platform (GCP) Marketplace for Kubernetes. De tool is beschikbaar als Google Click to Deploy containers om het eenvoudig naar de Google Kubernetes Engine (GKE) te kunnen uitrollen, Aangezien Spark Operator open source is en naar iedere Kubernetes-omgeving kan worden uitgerold, zijn er op GitHub Helm-charts beschikbaar voor de installatie-instructies.

De dienst is alleen beschikbaar voor het gebruik van Kubernetes via GCP. Het is niet bekend of de tool ook beschikbaar gaat komen voor de Kubernetes-diensten Azure Kubernetes Service/AKS van Microsoft of Elastic Container Service/EKS van AWS.