Nvidia heeft zijn software suite voor het virtualiseren van AI-workloads, AI Enterprise, algemeen beschikbaar gemaakt. De oplossingen zijn geschikt voor serveromgevingen op basis van VMware vSphere en serverinfrastructuur van diverse leveranciers.

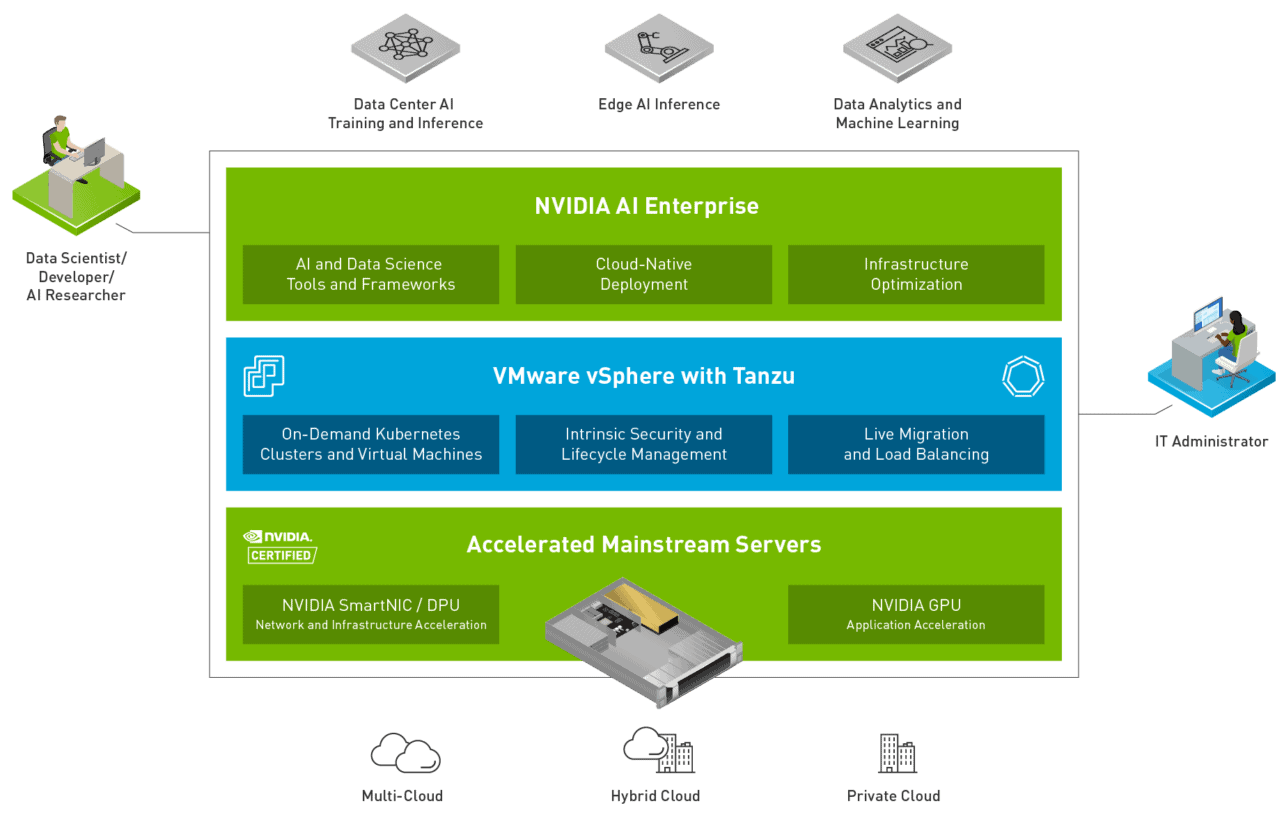

Met de AI Enterprise-oplossingen krijgen bedrijven de beschikking over een ‘end-to-end’ cloudgebaseerde suite van AI- en data analytics-software. De suite omvat Nvidia-technologie voor het snel uitrollen, beheren en schalen van AI workloads in hybrid cloud-omgevingen.

AI-tools en OEM’s

Het gaat hierbij om AI-tools en -frameworks als Nvidia RAPIDS, TensorFlow, PyTorch, Nvidia TensorRT en Nvidia Triton Inference Server. De oplossingen maken gebruik van Nvidia GPU-technologie, VMware vSphere met Tanzu en draaien op serverinfrastructuur van diverse OEM-leveranciers.

Belangrijke hardwarepartners zijn onder meer Dell Technologies, Atos, Gigabyte, HPE, Lenovo, Inspur en Super Micro. Dell levert een aparte Dell EMC VxRail hyperconverged platform voor het ondersteunen van AI Enterprise. Domino Data Lab heeft zijn Domino Enterprise MLOps-platform ook voor AI Enterprise geschikt gemaakt. Ook krijgen klanten voor het beheer de juiste ondersteuning van de chipgigant.

Toepassing AI Enterprise

Met de AI-oplossingen kunnen bedrijven makkelijker AI inzetten in hun omgevingen, geeft Nvidia aan. Door AI Enterprise op Vmware vSphere te draaien, krijgen beheerders een compleet platform voor hun specifieke workloads in handen. Dit AI-platform is volgens Nvidia makkelijk uit te rollen, schalen en beheren.

AI Enterprise is nu beschikbaar via Nvidia-partners. De abonnementskosten starten vanaf ongeveer 1.700 euro (2.000 dollar) per CPU voor één jaar. Dit inclusief Business Standard support. Permanebte licenties komen vanaf 3.000 euro (3.595 dollar), maar vereisen wel een apart support-abonnement.