Wetenschappers aan de University of Massachusetts Amherst en Stanford claimen een algoritmisch kader te hebben ontwikkeld, waarmee gegarandeerd kan worden dat kunstmatige intelligentie bepaalde grenzen niet overschrijdt.

Het kader maakt gebruikt van zogenaamde Seldonian algoritmes, in tegenstelling tot de machine learning (ML)-algoritmes, die op het moment in bestaande AI-applicaties worden gebruikt. De wetenschappers hopen met deze nieuwe algoritmes uiteindelijk applicaties te kunnen ontwikkelen, die op het moment niet mogelijk zijn met ML-algoritmes.

Robotwetten

De naam “Seldonian” is afgeleid van de protagonist uit de boekenreeks Foundation van schrijver Isaac Asimov. In deze reeks worden de bekende “Laws of Robotics” van Asimov voor het eerst geïntroduceerd. Deze drie AI-wetten moeten ervoor zorgen dat een robot mensen niet verwondt, opdrachten opvolgt die niet in strijd zijn met de eerste wet en dat de robot zijn eigen bestaan beschermt.

De nieuwe Seldonian algoritmes zouden enigszins gezien kunnen worden als een uitbreiding op deze oorspronkelijke robotwetten, waarbij de garantie er is dat de robots door machine learning niet alsnog onwenselijk gedrag vertonen.

ML-algoritmes ontoereikend

Op het moment wordt kunstmatige intelligentie ingezet bij een breed scala aan applicaties, van gezichtsherkenning tot het voorspellen van de aandelenmarkt. De wetenschappers geven echter aan dat de gebruikte ML-algoritmes niet toereikend zijn wanneer het gaat om situaties waarin accuratesse van groot belang is.

Zo wordt Amazon’s gezichtsherkenningssoftware Rekognition in Amerika ingezet door de politie om verdachten op te sporen. De software zou het beste werken wanneer de nauwkeurigheidsdrempel laag wordt ingesteld. Dit zorgt er echter voor dat de AI duidelijke raciale vooroordelen gaat vertonen.

Seldonian algoritmisch kader

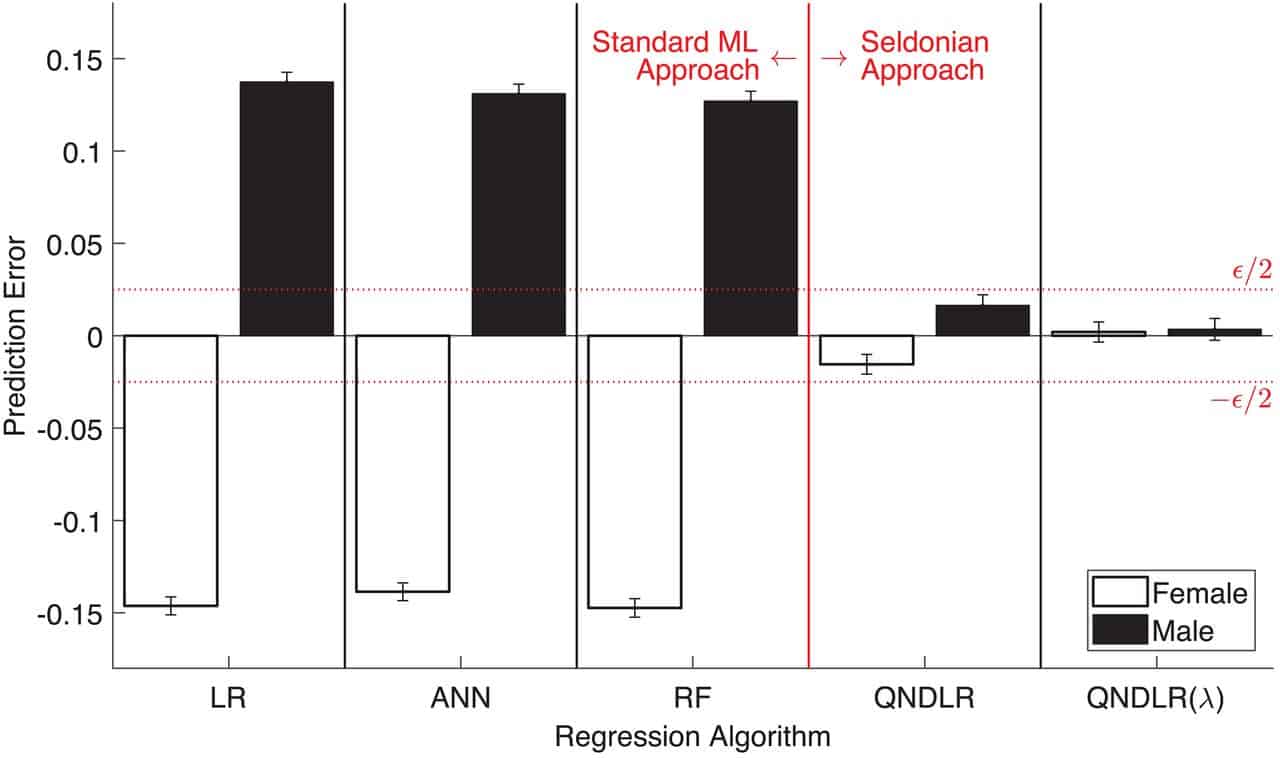

Met Seldonian algoritmes zou dit probleem volgens de betrokken wetenschappers voorkomen kunnen worden. Om de algoritmes te demonstreren is het nieuwe kader ingezet om een AI systeem te creëren voor het toedienen van insuline bij diabetici en het voorspellen van het Grade Point Average (GPA) van studenten, waarmee de geleverde prestaties van een student op een internationale schaal weergegeven kunnen worden.

In het geval van het toedienen van insuline kreeg het AI-systeem de opdracht om ervoor te zorgen dat patiënten niet crashten, terwijl het systeem zelf leerde wat de optimale dosering was. Bij het voorspellen van het GPA moest de kunstmatige intelligentie dat op een dusdanige manier doen dat er geen geslachtsdiscriminatie voorkwam. Beide implementaties van de Seldonian algoritmes bleken effectief en zouden volgens de wetenschappers het bewijs zijn dat de algoritmes succesvol ingezet kunnen worden bij het voorkomen van ongewenst gedrag.

Verantwoording AI bij ontwikkelaars

Het belangrijkste verschil tussen ML- en Seldonian algoritmes is waar de verantwoording voor het gedrag van de kunstmatige intelligentie wordt gelokaliseerd. Bij ML-algoritmes zou die verantwoording op de schouders van de eindgebruiker rusten, terwijl deze bij Seldonian algoritmes bij de ontwikkelaars ligt.

Dit gebeurt door het systeem op een mathematische manier de juiste beperkingsmaatregelen op te leggen. In plaats van het systeem door te geven om geen geslachtsdiscriminatie te vertonen bij het voorspellen van GPA’s, krijgt de AI bijvoorbeeld de opdracht om het GPA accuraat te voorspellen en daarbij het verschil tussen de voorspelde en daadwerkelijke score niet boven een bepaalde drempelwaarde te laten komen, wanneer daarbij het geslacht van de studenten in acht wordt genomen.

Nieuwe applicaties kunstmatige intelligentie

Op deze manier zouden Seldonian algoritmes bestaande applicaties accurater kunnen maken. De wetenschappers hopen echter dat de algoritmes in de toekomst voor meer ingezet kunnen worden dan alleen het vervangen van ML algoritmes. Zo zou het mogelijk moeten zijn om nieuwe applicaties te ontwikkelen, die voorheen te riskant waren met ML algoritmes.