Snowflake integreert alle LLM’s van de Europese LLM-ontwikkelaar Mistral AI in zijn Data Cloud-omgeving, meer specifiek in Snowflake Cortex. Klanten van Snowflake’s cloudomgeving kunnen hiermee makkelijker en op schaal specifieke LLM-apps bouwen.

De komst van de diverse LLM’s van Mistral AI naar Snowflake Data Cloud geeft gebruikers de mogelijkheid om de LLM’s direct te gebruiken voor het ontwikkelen van op AI gebaseerde applicaties. De integratie loopt via Snowflake Cortex, de beheerde dienst van de dataspecialist voor het bouwen van op LLM’s gebaseerde applicaties.

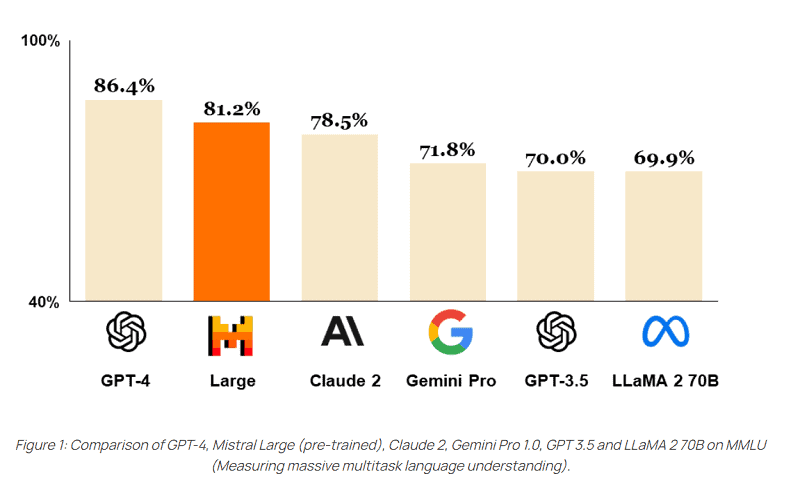

Deze beheerde dienst biedt nu het nieuwe Mistral Large-model. Volgens de Europese LLM-ontwikkelaar kan dit LLM zich meten met bijvoorbeeld GPT-4 van OpenAI. Daarnaast zou het beter presteren dan GPT-3.5, Gemini Pro van Google en Claude 2 van Anthropic. Ook de Mistral Mixtral 8x7B- en Mistral 7B-LLM’s zijn nu, in public preview, via Snowflake Cortex voor klanten beschikbaar.

Uitgebreide LLM-keuze in Cortex

De toevoeging van de Mistral LLM’s aan Snowflake Cortex geeft gebruikers meer mogelijkheden voor het bouwen van hun op AI gebaseerde applicaties. Deze applicaties kunnen zij vervolgens direct inzetten voor het analyseren van de data binnen hun Snowflake Data Cloud-omgeving en daarbij profiteren van de security-, privacy- en governance features die dit platform hiervoor biedt.

Daarnaast kunnen zij via Snowflake Cortex applicaties ontwikkelen voor specifieke zakelijke use cases. De beheerde dienst biedt hiervoor een reeks van specialistische LLM’s, onder andere voor sentimentsnanalyse, vertalingen en samenvattingen. Binnen de beheerde LLM-dienst van de dataspecialist is hiervoor ook het populaire LLaMA 2-model van Meta beschikbaar.

Ook biedt de dataspecialist in samenwerking met Nvidia, naast andere tools, een GPU-gebaseerd full stack rekenkrachtplatform op basis van Nvidia Triton Inference Server. Hiermee hoeven gebruikers zich ook geen zorgen te maken over de benodigde rekenkrachtinfrastructuur voor het bouwen van op LLM’s gebaseerde applicaties.

Mistral LLM’s meer beschikbaar

Voor Mistral AI betekent de samenwerking weer een mogelijkheid om zijn LLM’s aan een groter (zakelijk) publiek ter beschikking te stellen. Niet alleen via Snowflake levert de Europese LLM-ontwikkelaar nu zijn modellen. Recent werden hiervoor ook deals gesloten met Microsoft, IBM en AWS. Deze laatste aanbieder gaat Mixtral 8x7B en Mistral 7B via Amazon Bedrock aanbieden.

Investering Snowflake Ventures

Bovendien krijgt Mistral AI als kers op de taart nog een financiële injectie van Snowflake. Via het investeringsvehikel Snowflake Ventures krijgt de Europese LLM-ontwikkelaar een niet openbaar gemaakt investeringsbedrag.

Als onderdeel van de deal met Microsoft ontving Mistral AI ook van deze cloudaanbieder onlangs een investering van ongeveer 15 miljoen euro (16 miljoen dollar).

Lees ook: LLM voor Europa: Mistral AI zet Europa op de AI-kaart