AWS kondigt een preview aan van EC2 P4de. Deze instance is geschikt voor het sneller trainen van machine learning-modellen.

De aangekondigde Amazon EC2 P4de-instance van de techgigant moet het mogelijk maken machine learning (ML)-modellen sneller te trainen voor toepassing in neurale netwerken. Ook moeten deze instances HPC voor applicaties versnellen.

Denk bijvoorbeeld aan applicaties die momenteel nog supercomputer-omgevingen nodig hebben. Bijvoorbeeld voor het analyseren van seismische activiteit, computional fluid dynamics-software en andere veel rekenkracht vereisende workloads.

Technologie

Onder de motorkap van de instance bevinden acht Nvidia A100 GPU’s met ieder 80 GB aan onboard-geheugen. Hierdoor kan volgens AWS een AI-model tot 60 procent sneller worden verwerkt dan bij de vorige Amazon P4d-instances. Ook tegen 20 procent minder kosten.

De Nvidia GPU’s worden gecombineerd met 96 virtuele CPU’s en 1,1 TB aan geheugen. Voor opslagcapaciteit beschikken de 8 TB aan lokale NVMe flash storage. Deze lokale storage moet de instance sneller maken en minder latency geven, dan wanneer de storage in een ander deel van het datacenter staat.

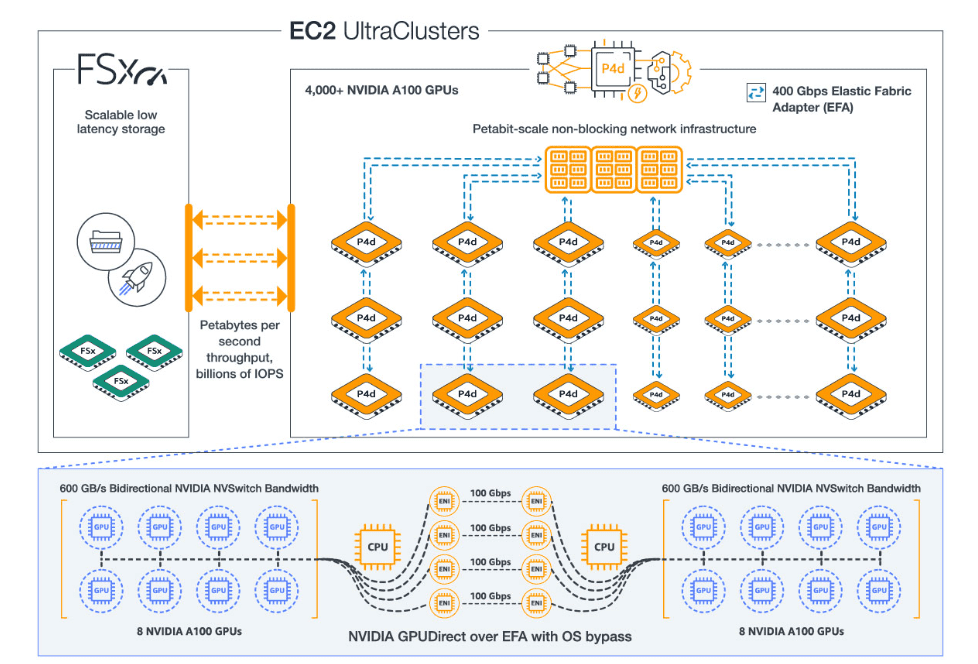

De Amazon P4de-instances draaien op EC2-UltraClusters. Dit zijn speciale hardware-omgevingen in de diverse datacenters van AWS. Deze EC2-UltraClusters richten zich in het bijzonder op het leveren van hoge prestaties. Hierbij krijgen klanten ook toegang tot een petabit-schaal van non-blocking netwerkinfrastructuur. Ook bieden de speciale EC2-clusters mogelijkheden voor het stroomlijnen van diverse dataopslagtaken.

Onlangs werden ook de Amazon C7-instances geïntroduceerd op basis van de eigen Graviton3-processors. Tevens biedt AWS AI-chips als de Inferentia-processor voor interferentietaken en Trainium voor AI-training.