De plaatsing van een watermerk op afbeeldingen uit een AI-beeldgenerator is plots in een stroomversnelling gekomen. OpenAI pakt de plaatsing aan vanuit de ontwikkelaarskant, terwijl Meta het watermerk zal toevoegen na een eigen controle. De updates zetten geen rem op de creatie van schadelijke inhoud, maar OpenAI hoopt dat het watermerk wel al zorgt voor een groter vertrouwen in online afbeeldingen.

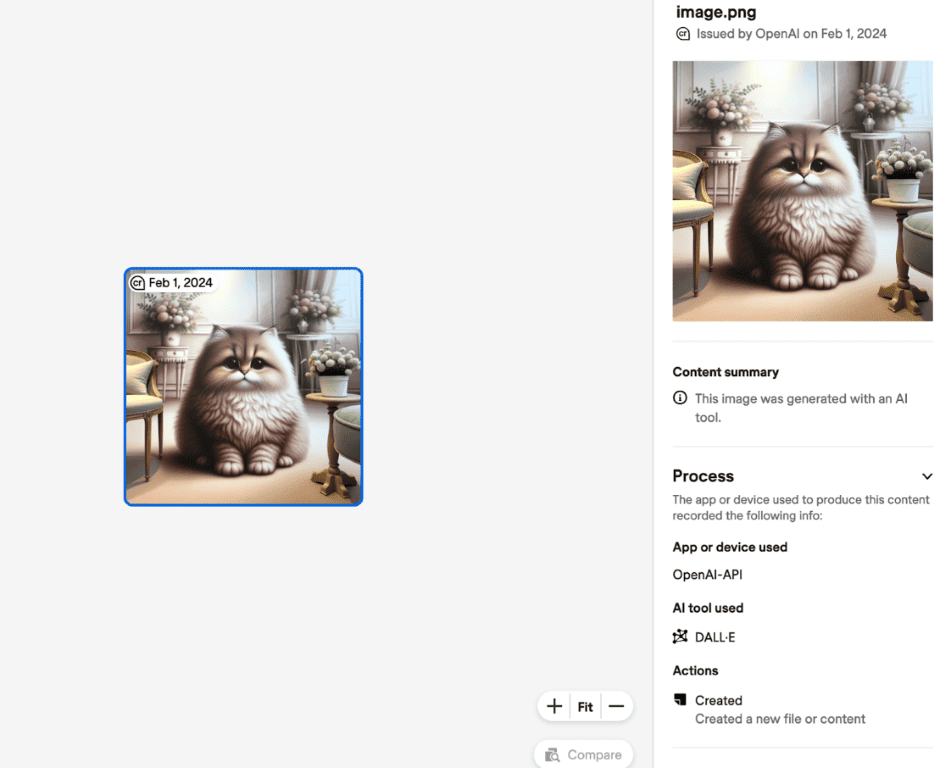

OpenAI zegt de C2PA-standaard te gaan implementeren. Deze standaard is niet speciaal ontworpen voor AI-afbeeldingen, want de ontwikkeling van officiële wetgevingen en standaarden laat nog grotendeels op zich wachten doordat AI nog een redelijk nieuwe technologie is.

Het geeft wel als voordeel dat onder andere de media onmiddellijk profijt hebben van de implementatie. De C2PA-standaard zet namelijk metadata in de media, waardoor in de niet-publiekelijke info van een afbeelding te zien zal zijn dat het om een AI-gegenereerde afbeelding gaat. Media kan hierdoor sneller afbeeldingen controleren op echtheid.

De metadata zal onmiddellijk worden toegevoegd voor afbeeldingen gemaakt op de website van ChatGPT en via de API voor DALL-E 3. Afbeeldingen die gegenereerd worden vanaf de mobiele mogelijkheden, krijgen het watermerk vanaf 12 februari.

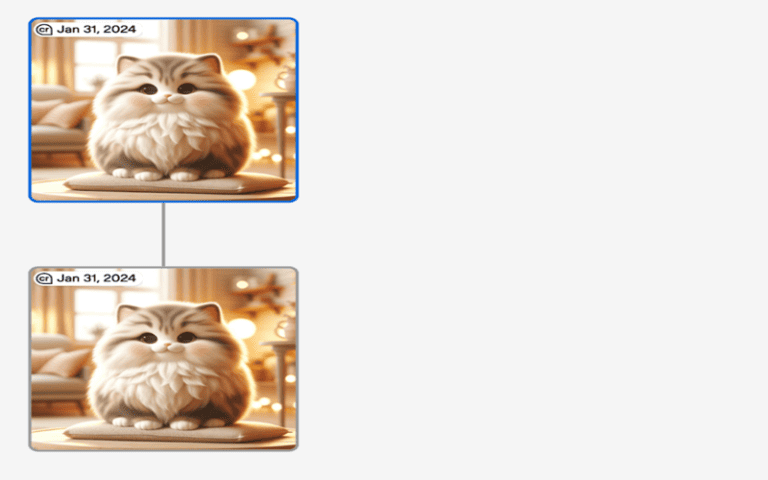

CR-symbool

Aan de implementatie van de standaard hangt OpenAI ook een zichtbaar aspect. Hiervoor introduceert het een CR-symbool. Dit symbool zal verschijnen in de linkerbovenhoek van iedere afbeelding.

Volgens OpenAI zal de combinatie van beide methodes kunnen bijdragen aan het vergroten van de betrouwbaarheid van afbeeldingen die online circuleren. Het zichtbare symbool is nodig om de problemen met metadata aan te kunnen pakken: “Het kan gemakkelijk per ongeluk of opzettelijk worden verwijderd. De meeste sociale-mediaplatforms verwijderen tegenwoordig bijvoorbeeld metadata van geüploade afbeeldingen, en acties zoals het maken van een screenshot kunnen deze ook verwijderen.”

Bron: OpenAI

Meta checkt iedere afbeelding

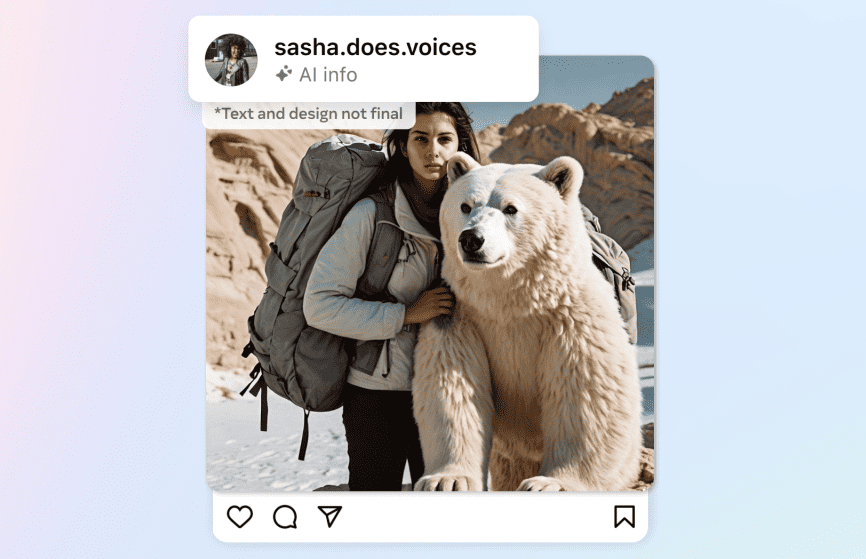

Meta maakte dan weer plannen bekend voor een eigen AI-label. Dit label wordt gebracht naar Facebook, Instagram en Threads. Iedere afbeelding die op één van deze social mediaplatformen wordt geüpload, zal hiertoe een controle krijgen.

Voor de extra controle van Meta, komt de implementatie van de C2PA-standaard bij OpenAI net op het gelegen moment. Meta wil in de toekomst namelijk geautomatiseerde software bouwen om AI-gegenereerde afbeeldingen te detecteren. Deze software zal een controle uitvoeren op de C2PA- en IPTC-standaarden. Deze standaarden zullen ook geïmplementeerd worden door Google, Microsoft, Adobe, Midjourney en Shutterstock, weet Meta. Er zal ook controle komen op andere vlakken, om de problemen met de C2PA-standaard te overwinnen.

De labels introduceren in de komende maanden op Facebook, Instagram en Threads. Het initiatief wordt later uitgebreid naar video en audio.

Bron: Meta

Meer controles nodig

Het label zorgt alvast dat gebruikers weten dat het gaat om een neppe afbeelding. Alleen moet schadelijke inhoud ook sneller worden aangepakt. De laatste weken zijn er voorbeelden opgedoken van AI-inhoud die schadelijk zijn voor het imago van bekende personen. Zo circuleerden er pornografische afbeeldingen van Taylor Swift en gingen er neppe audio-fragmenten rond waarin Amerikaans president Joe Biden kiezers zou overtuigen niet te komen stemmen.

Het plaatsen van een label zet geen rem op de creatie van dergelijke schadelijke inhoud. Daarvoor moeten AI-tools striktere en moeilijker te omzeilen veiligheidsmaatregelen nemen. De EU legt met de Digital Services Act alvast een deel van de verantwoordelijkheid bij social mediaplatformen. Zij moeten sneller ingrijpen en de verspreiding van dergelijke inhoud afremmen.

Lees ook: Big Tech krijgt nieuwe EU-regels, wat betekenen die voor gebruikers?